Spark 系列(七)—— 基於 ZooKeeper 搭建 Spark 高可用集羣

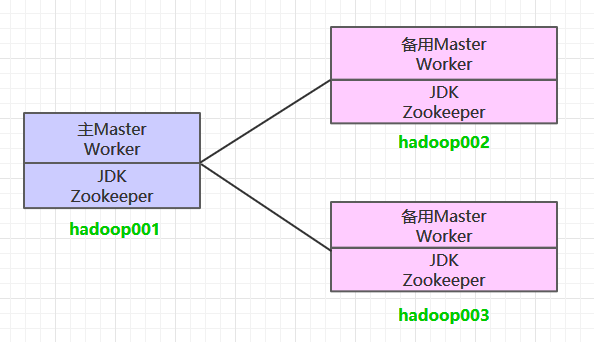

1、集羣規劃

這裏搭建一個 3 節點的 Spark 集羣,其中三臺主機上均部署 Worker 服務。同時爲了保證高可用,除了在 hadoop001 上部署主 Master 服務外,還在 hadoop002 和 hadoop003 上分別部署備用的 Master 服務,Master 服務由 Zookeeper 集羣進行協調管理,若是主 Master 不可用,則備用 Master 會成爲新的主 Master。html

2、前置條件

搭建 Spark 集羣前,須要保證 JDK 環境、Zookeeper 集羣和 Hadoop 集羣已經搭建,相關步驟能夠參閱:java

3、Spark集羣搭建

3.1 下載解壓

下載所需版本的 Spark,官網下載地址:spark.apache.org/downloads.h…git

下載後進行解壓:github

# tar -zxvf spark-2.2.3-bin-hadoop2.6.tgz

複製代碼

3.2 配置環境變量

# vim /etc/profile

複製代碼

添加環境變量:shell

export SPARK_HOME=/usr/app/spark-2.2.3-bin-hadoop2.6

export PATH=${SPARK_HOME}/bin:$PATH

複製代碼

使得配置的環境變量當即生效:apache

# source /etc/profile

複製代碼

3.3 集羣配置

進入 ${SPARK_HOME}/conf 目錄,拷貝配置樣本進行修改:vim

1. spark-env.sh

cp spark-env.sh.template spark-env.sh

複製代碼

# 配置JDK安裝位置

JAVA_HOME=/usr/java/jdk1.8.0_201

# 配置hadoop配置文件的位置

HADOOP_CONF_DIR=/usr/app/hadoop-2.6.0-cdh5.15.2/etc/hadoop

# 配置zookeeper地址

SPARK_DAEMON_JAVA_OPTS="-Dspark.deploy.recoveryMode=ZOOKEEPER -Dspark.deploy.zookeeper.url=hadoop001:2181,hadoop002:2181,hadoop003:2181 -Dspark.deploy.zookeeper.dir=/spark"

複製代碼

2. slaves

cp slaves.template slaves

複製代碼

配置全部 Woker 節點的位置:bash

hadoop001

hadoop002

hadoop003

複製代碼

3.4 安裝包分發

將 Spark 的安裝包分發到其餘服務器,分發後建議在這兩臺服務器上也配置一下 Spark 的環境變量。服務器

scp -r /usr/app/spark-2.4.0-bin-hadoop2.6/ hadoop002:usr/app/

scp -r /usr/app/spark-2.4.0-bin-hadoop2.6/ hadoop003:usr/app/

複製代碼

4、啓動集羣

4.1 啓動ZooKeeper集羣

分別到三臺服務器上啓動 ZooKeeper 服務:app

zkServer.sh start

複製代碼

4.2 啓動Hadoop集羣

# 啓動dfs服務

start-dfs.sh

# 啓動yarn服務

start-yarn.sh

複製代碼

4.3 啓動Spark集羣

進入 hadoop001 的 ${SPARK_HOME}/sbin 目錄下,執行下面命令啓動集羣。執行命令後,會在 hadoop001 上啓動 Maser 服務,會在 slaves 配置文件中配置的全部節點上啓動 Worker 服務。

start-all.sh

複製代碼

分別在 hadoop002 和 hadoop003 上執行下面的命令,啓動備用的 Master 服務:

# ${SPARK_HOME}/sbin 下執行

start-master.sh

複製代碼

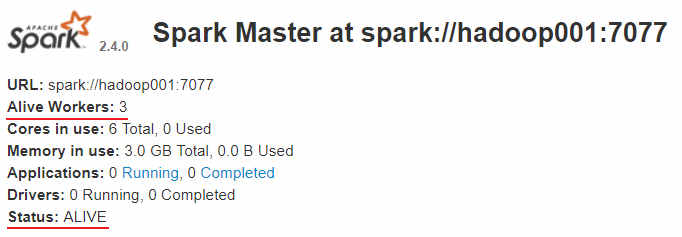

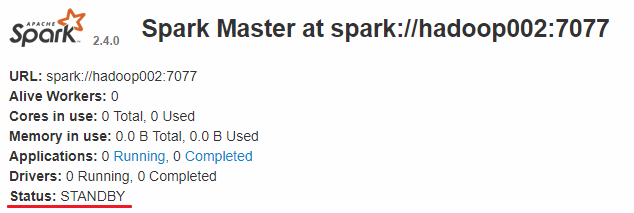

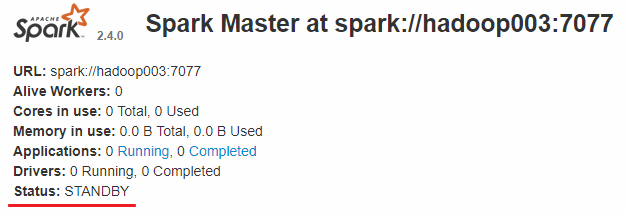

4.4 查看服務

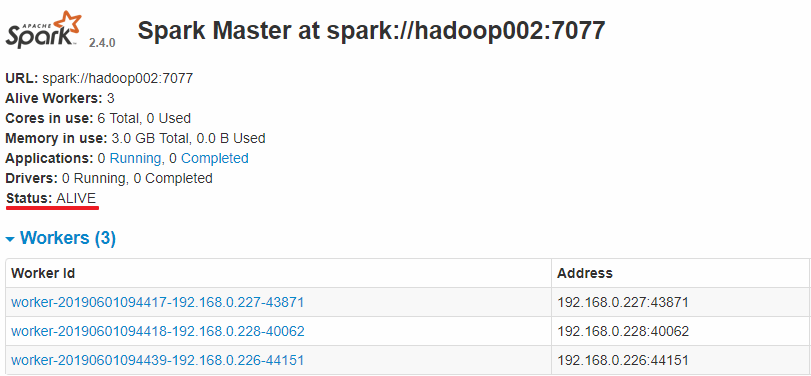

查看 Spark 的 Web-UI 頁面,端口爲 8080。此時能夠看到 hadoop001 上的 Master 節點處於 ALIVE 狀態,並有 3 個可用的 Worker 節點。

而 hadoop002 和 hadoop003 上的 Master 節點均處於 STANDBY 狀態,沒有可用的 Worker 節點。

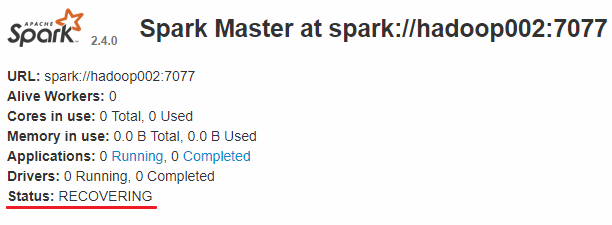

5、驗證集羣高可用

此時可使用 kill 命令殺死 hadoop001 上的 Master 進程,此時備用 Master 會中會有一個再次成爲 主 Master,我這裏是 hadoop002,能夠看到 hadoop2 上的 Master 通過 RECOVERING 後成爲了新的主 Master,而且得到了所有能夠用的 Workers。

Hadoop002 上的 Master 成爲主 Master,並得到了所有能夠用的 Workers。

此時若是你再在 hadoop001 上使用 start-master.sh 啓動 Master 服務,那麼其會做爲備用 Master 存在。

6、提交做業

和單機環境下的提交到 Yarn 上的命令徹底一致,這裏以 Spark 內置的計算 Pi 的樣例程序爲例,提交命令以下:

spark-submit \

--class org.apache.spark.examples.SparkPi \

--master yarn \

--deploy-mode client \

--executor-memory 1G \

--num-executors 10 \

/usr/app/spark-2.4.0-bin-hadoop2.6/examples/jars/spark-examples_2.11-2.4.0.jar \

100

複製代碼

更多大數據系列文章能夠參見 GitHub 開源項目: 大數據入門指南

- 1. Spark 系列(七)—— 基於 ZooKeeper 搭建 Spark 高可用集羣

- 2. Spark+Zookeeper搭建高可用Spark集羣

- 3. 基於 ZooKeeper 搭建 Spark 高可用集羣

- 4. Spark —— 高可用集羣搭建

- 5. Spark高可用集羣搭建(HA)

- 6. spark高可用集羣搭建

- 7. Hadoop 系列(八)—— 基於 ZooKeeper 搭建 Hadoop 高可用集羣

- 8. Kafka 系列(二)—— 基於 ZooKeeper 搭建 Kafka 高可用集羣

- 9. Spark集羣搭建【Spark+Hadoop+Scala+Zookeeper】

- 10. spark集羣搭建

- 更多相關文章...

- • Swarm 集羣管理 - Docker教程

- • Spring使用AspectJ開發AOP:基於XML和基於Annotation - Spring教程

- • 適用於PHP初學者的學習線路和建議

- • ☆基於Java Instrument的Agent實現

-

每一个你不满意的现在,都有一个你没有努力的曾经。

- 1. Spark 系列(七)—— 基於 ZooKeeper 搭建 Spark 高可用集羣

- 2. Spark+Zookeeper搭建高可用Spark集羣

- 3. 基於 ZooKeeper 搭建 Spark 高可用集羣

- 4. Spark —— 高可用集羣搭建

- 5. Spark高可用集羣搭建(HA)

- 6. spark高可用集羣搭建

- 7. Hadoop 系列(八)—— 基於 ZooKeeper 搭建 Hadoop 高可用集羣

- 8. Kafka 系列(二)—— 基於 ZooKeeper 搭建 Kafka 高可用集羣

- 9. Spark集羣搭建【Spark+Hadoop+Scala+Zookeeper】

- 10. spark集羣搭建